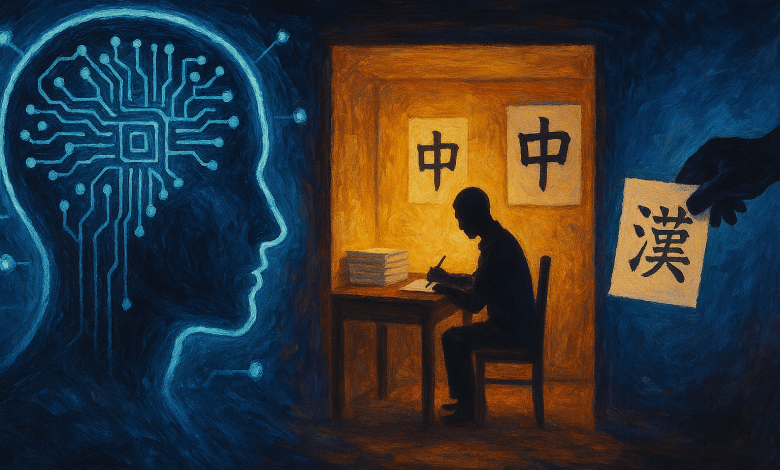

الذكاء الاصطناعي والغرفة الصينية ..

لعلك قد سمعتَ يومًا أحدهم يتحدث عن وعي الآلة وقدرتها على الفهم ولربما قد تفاقم حماسه للحديث عن سيطرتِهَا على العالم وغيرِهَا من القضايا الحديثة، لكن الأمر ليس بتلك السهولة التي يستخدمها في إنشاء جمله تلك، فللموضوع تعقيداتٌ وموانعُ نعرضها هنا بمقالتنا هذه.

يأتي سؤالُ الذكاءِ في سياق الوعي عادةً فنحن نشيرُ بالذكاء نحو الكائن الواعي لذاته ومحيطه ويتصرفُ بطريقةٍ تثير إعجابنا، وقد نال العقلُ ذاته شاملًا بذلك كافة مظاهره : نقاشاتٍ مطولةً عبر تاريخ البشر، إلى أن وصلنا اليوم لمعضلة الوعي الفلسفية في ظل تطور العلوم خصوصًا العصبية والفيزيائية، ومع التطور الذي لحق بالآلة وجعلها تستطيع التفاعلَ مع احتياجاتنا فإنَّ ذلك السؤال كبُرَ وتلك النقاشات تشعّبَت.

الذكاءُ الاصطناعي وأنواعه ..

قدَّم “الآن تورنغ” مقالته العلمية البحثية ”“Computing Machinery and Intelligence” في عام 1950م وهي المقالة التي ناقش بها بإسهابٍ مسألةَ الذكاءِ بالآلة متجاوزًا الانشغال بسؤال الفلسفة عن وعي الآلة ذاتها والتركيز على مفهوم الذكاء والتفكير بصفته سلوكا ونتاجًا1 ، وخلاصة ورقته في ما يعرف بعد ذلك بامتحان تورنغ للذكاء، التالي:

هناك محكّمٌ (إنسان) يقدم أسئلةً مكتوبة عبر واجهةٍ نصية ولا يستطيع رؤيةَ من الذي يجيب،

وهناك اثنان أحدهما ”آلة“ والآخر ”إنسان“ ، يجيبان وتُنقل للمحكٌم الإجابات مكتوبةً،

فإذا لم يستطع المحكّم التفريق بين إجابات الآلة والإنسان بنسبة تتجاوز ٧٠٪ فإن الآلة تكون قد نجحت بالامتحان ،

وقد شملت مقالته نقاشًا مطولا حول التفكير للآلة، وفي عام1956 م ابتكر الباحث الأمريكي ”جون مكارثي“ مصطلح الذكاء الاصطناعي مع مجموعة من الباحثين العلماء بمؤتمر أقيم بكلية دارتموث بالولايات المتحدة الأمريكية مع مجموعة من العلماء2،

ومنذ تلك السنوات كانت ظاهرة الذكاء الاصطناعي قد انبثقت ليكون لها أنصار وفق ما يعتقدونه بإمكانياتها وهنا يجدر بنا ذكر أنواعها وهي بالمجمل عدة أنواع يهمنا فيها بالمجمل :

-الذكاء الاصطناعي الضيق (Weak AI أو Narrow AI)

يُعرَف أيضًا بـ”الذكاء الاصطناعي المحدود”، إذ يكون النظام مصممًا لإنجاز مهمة محددة جدًا، مثل التعرّف على الوجوه أو قيادة السيارة ذاتيًا ولا يمتلك هذا النظام فهمًا حقيقيًا أو وعيًا بالمهام التي يؤديها، بل يتبع خوارزميات محددة بدقة. 3من أمثلته : المساعدات الذكية مثل Siri وGoogle Assistant.

– الذكاء الاصطناعي العام (General AI)

يُشار إليه أحيانًا باسم “الذكاء الاصطناعي القوي” (Strong AI)، وهو الذكاء القادر على التعلّم والفهم والأداء في مجالات معرفية مختلفة، مشابهًا بذلك الذكاء البشري العام، وهذا النوع ما يزال في طور الأبحاث النظرية، حيث لا توجد حاليًا آلات لديها وعي بشري شامل أو ذكاء عام مماثل.4

– الذكاء الاصطناعي الفائق (Super AI)

يفترض هذا المستوى: الذكاء الذي يتجاوز ويتفوق على الذكاء البشري في كل المجالات تقريبًا، ويثير هذا النوع مخاوف فلسفية وأخلاقية كبيرة، لإمكانية تجاوزه قدراتنا على التحكم وهذا النوع مازال في طور الخيالات والطموحات.5

يتضح لنا أن ما يطلق عليه الذكاء الاصطناعي القوي هو ما عليه الجدل أما الفائق فما زال في عالم الخيال المطلق.

ثمة تيارٌ عريض لأنصار الذكاء الاصطناعي القوي برغم أنه نظري للآن لكن التطورات العلمية – خصوصا مع تطور الحوسبة العصبية منذ ثمانينيات القرن الماضي، ببروز منهج بديل يهدف إلى محاكاة الشبكات العصبية الحيوية باستخدام نماذج رياضية مستوحاة من الدماغ وووصوله إلى ذروته في القرن الحادي والعشرين مع القفزات العلمية في خوارزميات التعلم العميق (Deep Learning) – دفعت للسؤال عما إذا كان من الصواب الاعتقاد بأن للآلة فهما ووعيا، وما أن يبدأ الجدل في هذا المضمار إلا وظهرت حجة الغرفة الصينية ل“جون سيرل“، وما أن يُنظر للعقل بصفته عملا وظيفيا كما تزعم بذلك الفلسفة الوظائفية إلا وظهرت حجة الأمة الصينية ل ”نيد بلوك“، وهذه الأخيرة سنناقشها بمقالة أخرى.

حجة الغرفة الصينية …

في نهاية السبعينات من القرن الماضي ومع التطور الذي لامس أجهزة الحاسوب وتداولها بين الناس بدأت فكرة فهمها للغة الإنجليزية تدب على ألسنة بعض صانعيها الذين أُطلق عليهم تيار الذكاء الاصطناعي القوي، في مقالة نشرها جون سيرل لتوجيه نقده لهم عام ١٩٨٠ بعنوان ”Minds, Brains, and Programs,“

تتناول هذه الورقة بالتفصيل ما يزعمه بعضهم من فهم الحواسيب، وتقدم مقالته عدة انتقادات أهمها رده على برنامج شانك Shanks للذكاء الاصطناعي، الذي يعتبر نواةً لما نشهده اليوم من ذكاء للأجهزة كبير، وكان “شانك” قد قدم برنامجه بالاعتماد على قصص من الممكن بعدها للكمبيوتر الإجابة بناء على خبراتٍ محفوظة سابقًا حيث أن الهدف من البرنامج هو محاكاة قدرة الإنسان على فهم القصص،

والمثال الذي تناوله جون سيرل بالرد،

كان عن شخص دخل مطعم مثلا وطلب هامبرغر وحين جاءه رأى أنه محترق فاستشاط غضبا وترك المطعم،

ولو سألناك هل أكل هذا الشخص الهامبرغر؟ لقلت ”لا“ بناء على فهمك القصة ولو جئنا بسرد آخر لها وقلنا أنه دخل وطلب الهامبرغر وكان سعيدا بها وأعطى البائع بخشيشا ثم سألناك ”هل أكل الهامبرغر“ لقلت نعم بناء على فهمك للقصة ، وبالقياس فإن برنامج ”شانك“ أيضًا سيجيب على الأسئلة كما تفعل أنت وبالنتائج ذاتها عبر تزويده بتعليمات مرتبطة بالسياق والقصة، فهل هذا يعني أنه فهم القصة؟ هكذا يقدم لنا جون سيرل القضية ثم يعلق قائلا وشارحا:

“يدعي أنصار الذكاء الاصطناعي القوي أنه في تسلسل الأسئلة والأجوبة هذا، لا تحاكي الآلة القدرة البشرية فحسب، بل أيضا

1. يمكن القول حرفيا إن الآلة تفهم القصة وتقدم الإجابات على الأسئلة،

2. أن ما تفعله الآلة وبرنامجها يفسر القدرة البشرية على فهم القصة والإجابة على الأسئلة المتعلقة بها.”

يشرح لنا جون سيرل حجته بمقالته الشهيرة تلك من خلال الرد على ادعاء أن الآلة تفهم عبر انتقاده لبرنامج شانك بالتالي:

أنا شخص لا أجيد اللغة الصينية ولا أعرفها، وهي بالنسبة لي مكتوبةً مجرد خربشات وأشكال غير مفهومة،

آنا الأن بعرفة مغلقة، وخارج الغرفة أشخاص يرسلون لي نصوصا وتعليمات.

الدفعة الآولى كتابات بالصينية لم أفهمها ولا آعرف ما تعنيه رموز حروفها

الدفعة الثانية: كتابات صينية مع تعليمات بالإنجليزية تربط الدفعة الثانية بالأولى

الدفعة الثالثة:رموز صينية مع تعليمات بالإنجليزية لربط هذه الرموز بالدفعتين الأوليين، وهي تعليمات تساعدني على ربط النصوص بردود استجابة معينة.

يُسمّي الأشخاص بخارج الغرفة هذه الدفعات بالتالي: الأولى هي النص، والثانية هي القصة ، والثالثة هي الأسئلة والتعليمات هي البرنامج وأما ما أقوم بفعله وإرساله لهم : الإجابة.

لنفترض الآن أنني تلقيت بنفس السيناريو نصوصا إنجليزية وأنا بالأساس أتكلم الإنجليزية بصفتها لغتي الأم سيكون علي فهمها والإجابة ولنفترض أن المبرمج قد وضع تعليمات لي بالتعامل مع النصوص الصينية بطريقة تعطي إجابات هي أيضا تجعلني وكأني أفهم الصنية، فحين يرسل لي شخص من خارج الغرفة نصا بالصينية أو الإنجليزية يعتقد أنني أجيد الاثنتين معا لكني فعليا لا أجيد ولا أفهم إلا لغة واحدة هي لغتي الإنجليزية.

ويكمل جون سيرل شرحه حول هذه النقطة ليبيّن لنا بأنه حينها بالتعامل مع الإنجليزية إنسان يفهم ويدرك ، في حين تعامله مع الصينية يكون مثل الكبيوتر أجري عمليات لا يفهمها،وبالتالي فإن الادعاء الآول بقول أن الآلة تفهم القصة يكون خاطئا فالحاسوب مثل حالته بالتعامل مع الصينية لا يفهم شيء بل حتى الانجليزية بالنسبة له، لأنه سيتعامل معها أيضا وفق التعليمات بلا فهم . أي أن الكمبيوتر يعالج النصوص ولا يفهمها

وبالنسبة للادعاء الثاني بأن ما تفعله الآلة (الكبيوتر) يفسر لنا القدرة البشرية على الفهم يمكننا أن نرى أن الكمبيوتر وبرنامجه يعملان، بلا فهم6.

الغرفة الصينية باختصار

نالت حجة سيرل الغرفة الصينية الكثير من الجدل والنقاش وقبل عرض أشهر الردود التي قام ”جون سيرل ” بالرد عليها أيضًا في ورقته، أعرض عليكم هنا مجمل القصة كما نشرها هو مرة أخرى بكتابه mind

يقول :

”إنني لا أفهم اللغة الصينية إطلاقًا. في الحقيقة لا يمكنني حتى التمييز بين الكتابة الصينية والكتابة اليابانية. لكن تخيَّل أنني حُبِستُ في غرفة فيها صناديق مليئة بالرموز الصينية، ولديَّ كتابُ قواعد يشبه برنامجًا حاسوبيًّا، يمكنني بواسطته الإجابة عن الأسئلة المطروحة عليَّ باللغة الصينية. تصلني رموزٌ لا أعرف أنها أسئلة، فأتصفَّح كتاب القواعد لأرى ما ينبغي عليَّ فعله، ثم آخذ رموزًا من الصناديق وأُجري عليها عملياتٍ وفق التعليمات في البرنامج، وأُسلِّم الرموز المطلوبة، والتي تُفَسَّر على أنها إجابات. يمكننا أن نفترض أنني أنجح في اجتياز اختبار تورينغ للفهم باللغة الصينية، ومع ذلك لا أفهم كلمةً واحدةً من الصينية. وإذا كنتُ لا أفهم الصينية لمجرَّد تنفيذي للبرنامج الحاسوبي المناسب، فلن يفهمه أي حاسوب آخر لمجرَّد تنفيذه للبرنامج؛ لأن الحاسوب لا يملك شيئًا لا أملكه أنا.

ويمكنك أن تُدرِك الفرق بين الحوسبة والفهم الحقيقي إذا تخيَّلتَ وضعي وأنا أجيب عن الأسئلة باللغة الإنجليزية أيضًا، وفي الغرفة نفسها أتلقى أسئلةً بالإنجليزية وأجيب عنها. من الخارج، تبدو إجاباتي عن الأسئلة بالإنجليزية وبالصينية متساوية في الجودة، وأجتاز اختبار تورينغ في الحالتين. ولكن من الداخل، هناك فارقٌ هائل؛ ففي اللغة الإنجليزية أفهم معنى الكلمات، أما في اللغة الصينية فلا أفهم شيئًا على الإطلاق. في الصينية، أنا مجرد حاسوب“7.

الردود على الغرفة الصينية

نشر جون سيرل بالإضافة لحجته الردود عليها وقد قدم أيضا انتقادات موجهة لهذه الردود، وهنا أشهرها :

رد النظام (Systems reply) :

قدم مجموعة باحثين باركلي هذا الانتقاد معتبرين الحجة الصينية تتجاهل أن الفهم قد حدث بالفعل من خلال النظام ككل، فنحن نتفق معك بأن الشخص داخل الغرفة المغلقة لم يفهم شيئا من الصينية لكن حالة الفهم حدثت بالفعل من خلال النظام بأكمله: التعاليم والشخص والرموز وعملية تطبيق التعاليم، حتى لو كان الشخص نفسه لا يفهم شيء

– استطاع جون سيرل قصم هذا الاحتجاج من خلال رده عليها بورقته عبر شرحه وافتراضه بأن رد النظام ليس كافيا لإثبات الفهم :

- لو قمنا بحذف الأدوات المساعدة وجعلنا هذا الشخص يحفظ كل التعاليم ويقوم بكل الحسابات بذهنه ودعونا نجعله أيضًا خارج الغرفة فإننا حينها لو أعطيناه رموزا بالصينية وقام بتطبيق كل شيء من خلال حفظه فذا لا يعني أنه فهم شيئا وهنا حتى النظام ككل لن يحقق معنى الفهم.

- لو كنت أجيد التعامل مع الرموز الصينية بالتعاليم المساعدة لتطبيق ردة الفعل فإن امتحان تورنغ لو جاء بالانجليزية سانجح به لأنها لغتي الأم وإذا جاء بالصينية فستنجح فيه لأني اطبق تعاليم التعامل مع الرموز، ومع ذلك فأنا بلغتي الإنجليزية أفهم ما هو مطلوب مني ومكتوب وردة فعلي في حين باللغة الصينية لا أفهم شيء لكني أطبق تعاليم البرنامج.

رد الريبوت The Robot Reply (Yale). :

فحوى هذا الرد يتضمن بأننا لو جعلنا حاسوب داخل روبوت مزود بكاميرا للرؤية ومنحناه أذرعة للحركة وكل ما يمكنه ممن المشي والتحرك وما نوده أن يفعل فإن هذا يقتضي أن يكون الحاسوب دماغا وبالتالي سيكون لديه فهما حقيقيا بدل الاعتماد على بيانات نقدمها ثم مخرجات ينتجها، وهذا الرد تلقي انتقادا من سيرل بأننا حتى لو فعلنا ذلك فهذا لا يعني أبذأ آن الروبوت يفهم بل هذا الحاسب سيتعامل مع ما يصله من الكاميرا أو حتى المجسات بطريقة التعامل مع الرموز ومعالجتها وفق القواعد المزود بها لكنه لا يملك أي نية أو قصدية كما يفعل الإنسان الواعي وهو لا يفهم المعاني بل يطبق المراد منه، ويضرب سيرل مثالا جيدا على نفسه فبدل من وضع حاسوب داخل روبوت، فلنفترض أنكم وضعتموني أنا فيه، وتصلني معلومات من الكاميرا والمجسات مثلا باللغة الصينية التي لا أفهمها لكني مزود بتعاليم بالانجليزية لتطبيق معالجة الرموز ومن ثم أنفذ المطلوب عبر الروبوت، وهنا هذا يعني أيضا أنني لم افهم شيئا رغم أني حركت الروبوت فمازالت تلك الرموز بلا معنى عندي أعيه.

رد المحاكاة الدماغية ، The Brain Simulator Reply:

يتخذ هذا الرد مبناه على أساس فلسفي ومستقبلي ماذا لو قمنا بمحاكاة البنية الدماغية وتجهيز الحاسوب بطرق تحاكي حالات العصبونات فيزيائيا؟ إنه هكذا سيحمل قدرة للفهم واستيعابا وبالتالي فإنه سيكون واعيا ويقوم بأمور كثيرة تشبه ما نفعله ونفهمه، وهكذا فإن مشكلة الغرفة الصينية ومسألة أن الكمبيوتر يتعامل مع المعالجة الرمزية دون فهم للمعاني ستصبح خاطئة حينما نصنع هذه المحاكاة،

يرد جون سيرل على هذا الرد عبر الاستناد على أننا لليوم لا نعلم بالأساس كيف يعمل الدماغ لتأسيس القصدية والفهم، فنحن حتى لو حاكينا أعمال الدماغ وظيفيا فنحن لا نعرف تماما كيف يصنع الدماغ حالات الوعي وليس لنا أي دراية بذلك وبالتالي فإن حالة الغرفة الصينية ستكون ملازمة للنموذج المراد تصنيعه بالمحاكاة.

ختامًا

هناك ردود أخرى تناولها سيرل لكن ما سبق كان أهمها وقد استمر الجدل لليوم حول ظواهر مثل الوعي والقصدية والخبرات الذاتية لم يستطع العلم حلها وهي للآن في طور الجدل الفلسفي وغالبا لن تجد لها موضعا بالعلم لتحديات كبرى تواجه العلم ذاته وعجزه عن تخطي الحدود من الممكن اختصار المسألة بهذه العبارات المنشورة بمقالة لمجموعة من العلماء :

“وفقًا لأكثر أشكال الفيزيائية اختزالًا، تخبرنا العلوم أن كل شيء، بما في ذلك الحياة والعقل والوعي، يمكن اختزاله إلى سلوك أصغر المكوِّنات المادية. أنت لست سوى عصبوناتك، وعصبوناتك ليست سوى أجزاءٍ ضئيلةٍ من المادة. وهنا، تختفي الحياة والعقل، ولا يتبقّى سوى المادة الجامدة.”8

عصام مطير – سلسلة قراءات فلسفية – منصة ركائز